La inteligencia artificial descifra tablillas cuneiformes mesopotámicas de hace 4.500 años

El algoritmo ha sido alimentado con los modelos 3D de casi 2.000 de estas inscripciones que permiten observar con mayor precisión los signos y compararlos entre sí

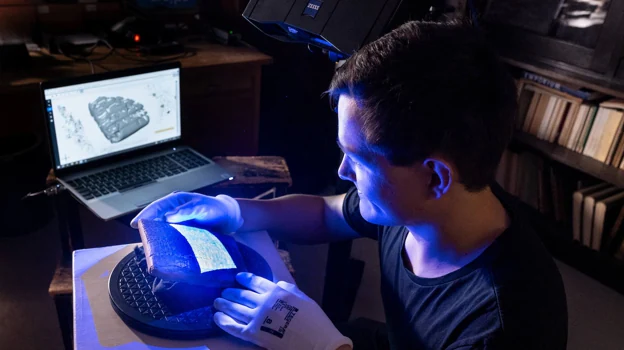

Una tablilla de escritura cuneiforme de la antigua Mesopotamia. Algunas solo miden unos centímetros.

El primer descifrado de las tablillas de escritura cuneiforme de la antigua Mesopotamia tiene su origen en una taberna alemana. En 1801, con unas pintas de más, el lingüista Georg Friedrich Grotefend se apostó con sus amigotes que era capaz de descodificar aquellas misteriosas inscripciones y, sólo un año después, sus primeros descubrimientos fueron comunicados a la Real Sociedad de Gotinga. Sus hallazgos, 20 años anteriores a la lectura de la Piedra de Rosetta por parte de Champollion, serían después publicados como ‘Neue Beiträge zur Erläuterung der Babylonischen Keilschrift’. Ahora, el siguiente y trascendental paso para leer la escritura cuneiforme tiene lugar también en Alemania.

Un equipo interdisciplinar de investigación de la Universidad de Halle-Wittenberg (MLU), la Universidad de Ciencias Aplicadas de Mainz y la Universidad de Mainz ha presentado una Inteligencia Artificial (IA) que puede descifrar incluso los textos más difíciles de leer en estas tablillas con una alta tasa de aciertos. La IA llega para desvelarnos los detalles del origen de nuestra civilización, con la traducción de textos que datan de hace más de 4.500 años.

Los primeros caracteres sumerios, fueron prensados en arcilla húmeda con estiletes de caña o madera en la antigua Sumeria, en el sur de Mesopotamia. Las tablillas se dejaban después secar o se horneaban, adquiriendo así unas condiciones que han permitido su conservación hasta nuestros días. El tiempo, sin embargo, ha causado estragos. Los expertos estiman que un millón de estas tablillas siguen sin ser traducidas debido, fundamentalmente, a su mal estado y a la complejidad que añaden los muchos idiomas que se utilizaron en su escritura.

La IA ha llegado para poner solución a estos problemas. En lugar de fotografías, para este nuevo enfoque de investigación han sido utilizados modelos 3D de las placas, que una vez limpiados permiten observar con mucha mayor precisión los signos y compararlos entre sí. «Hasta ahora, acceder al contenido de las tablillas cuneiformes era difícil: había que saber exactamente lo que se buscaba y dónde, partir de muchos conocimientos previos», explica Hubert Mara, de la MLU.

El algoritmo ha sido alimentado con los modelos 3D de casi 2.000 tablillas cuneiformes, la mayoría procedentes de la Colección Hiprecht, la gliptoteca de Haft Tappeh, y unas 50 de una colección de la Universidad Martin Luther Halle-Wittenberg.

La IA diseñada a para su lectura funciona de manera similar al software OCR (Reconocimiento Óptico de Caracteres) convencional, que reconoce escritura y texto en imágenes y los convierte en texto informático. A partir de ahí, la IA compara, busca e identifica caracteres similares, separa los textos por idiomas y establece traducciones cuya fiabilidad supera el 90%.

«La lectura de las tablillas cuneiformes era tan difícil debido a que la luz y el ángulo exacto desde el que se miran influyen en gran medida en la capacidad de reconocimiento de determinados caracteres, pero eso ahora ya no es un problema», celebra Ernst Stötzner, otro investigador de la MLU, «aunque, sorprendentemente, nuestro sistema funciona incluso muy bien también con fotografías que en realidad son un material original más pobre«.

Hasta doce tipos de escritura

Anteriormente, investigadores de la Universidad de Tel-Aviv habían aplicado también la IA para la traducción al inglés de los textos del Código de Hammurabi, pero sólo consiguieron una traducción lineal, no demasiado diferente de la que logra cualquier smartphone con la aplicación adecuada. Lo específico del proyecto alemán es la capacidad de identificar signos y hasta doce tipos de escritura diferentes que, posteriormente, posibilitan la traducción.

«Hasta ahora hemos encontrado de todo, desde documentos judiciales hasta listas de abastecimiento», señala el investigador Hubert Mara.

Las conclusiones de esta investigación, publicadas en la revista ‘The Eurographics Association’, destacan que no es necesario poseer conocimientos previos de estas lenguas de cinco milenios de antigüedad para aplicar el algoritmo y obtener la traducción. Apuntan, además, los pasos que en el futuro podría seguir dando la aplicación de esta técnica.

«Nuestras investigaciones sobre localización de señales han demostrado que el conjunto de datos podría no ser el más adecuado para tareas de detección de señales, sino que las señales se pueden recortar y podría ser una buena base para una tarea de clasificación sin localización», afirman los investigadores en sus conclusiones, «con imágenes más pequeñas la calidad de los resultados tanto para el signo y el detector de cuña acoplado aumenta, por lo que un enfoque para mejorar los resultados puede ser dividir las imágenes de una tableta completa en cuadrados más pequeños«.

«Para mejorar la calidad del modelo en trabajos futuros», añaden, «la arquitectura podría estar más orientada hacia el método para objetos rotados… y omitir la localización de la cuña».